Trước đây trong cộng đồng bảo mật, các phương pháp truyền thống như tường lửa và phần mềm anti-virus thường được nhắc đến nhiều hơn, khi đó các khái niệm về đã xuất hiện nhưng việc ứng dụng vào thực tế còn hạn chế do sức mạnh tính toán và độ phức tạp của thuật toán AI. Vào cuối những năm 1990 và đầu những năm 2000, AI bắt đầu đóng một vai trò quan trọng trong các hệ thống phát hiện xâm nhập (IDS), sử dụng các kỹ thuật để phân tích mô hình lưu lượng truy cập mạng và phát hiện những điểm bất thường có thể cho thấy vi phạm bảo mật. Những năm 2000 cũng chứng kiến sự gia tăng sử dụng các kỹ thuật học máy trong an ninh mạng, áp dụng các thuật toán để phân tích mẫu dữ liệu và xác định các mối đe dọa tiềm ẩn. Phân tích hành vi (một lĩnh vực ứng dụng AI) đã trở nên nổi bật trong việc phát hiện phần mềm độc hại và các mối đe dọa mạng khác.

Xu hướng hiện tại liên quan đến việc sử dụng AI để tự động hóa các hoạt động an ninh mạng và giải quyết các mối đe dọa như . Trong đó, các mô hình học máy có thể xác định và phản hồi các hoạt động đáng ngờ có thể là dấu hiệu của một cuộc tấn công độc hại. Theo báo cáo Tình trạng An ninh mạng năm 2023 của Hiệp hội quốc tế về quản trị công nghệ thông tin (ISACA), AI đã được chứng minh là lĩnh vực rất có tiềm năng và ứng dụng hiệu quả trong hoạt động bảo mật. Bối cảnh an ninh mạng luôn tùy biến, đặc biệt các tác nhân đe dọa liên tục phát triển các chiến thuật và kỹ thuật mới để vượt qua các biện pháp phòng thủ hiện có.

Trong một cuộc khảo sát, Tập đoàn công nghệ IBM báo cáo rằng 90% tổ chức đang sử dụng AI cho an ninh mạng dưới một hình thức nào đó. Bất kỳ khả năng mới nào do AI cung cấp đều rất cần thiết, bởi 59% các doanh nghiệp cho biết họ đang thiếu nhân lực về an ninh mạng và chưa đến một nửa số tổ chức (42%) được khảo sát có mức độ tin cậy cao vào khả năng phát hiện và ứng phó với các mối đe dọa của các nhóm bảo mật.

Theo dự đoán của Kaspersky, các mối đe dọa an ninh mạng từ sự phát triển nhanh chóng của AI năm 2024 bao gồm:

Nhiều lỗ hổng phức tạp hơn

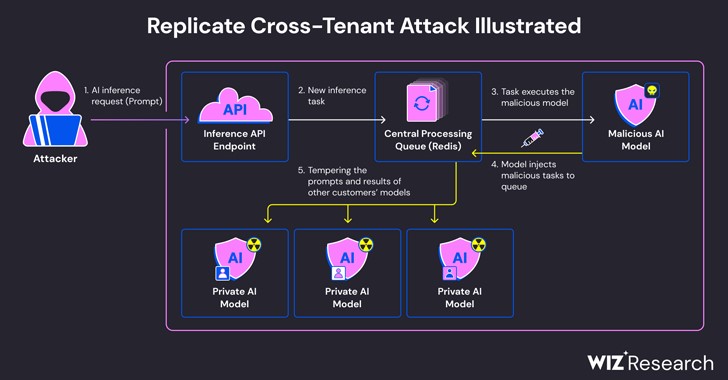

Khi các (LLM) được tích hợp vào các sản phẩm hướng tới người dùng, các lỗ hổng phức tạp mới có thể sẽ xuất hiện ở điểm giao thoa giữa AI tạo sinh và các công nghệ phát hiện lỗ hổng truyền thống. Điều này yêu cầu các nhà phát triển nâng cao các nguyên tắc và thực tiễn bảo mật mới, dẫn tới sự xuất hiện của trợ lý AI toàn diện cho chuyên gia an ninh mạng.

Sử dụng công nghệ AI để lừa đảo trực tuyến

Những kẻ lừa đảo sử dụng nhiều kỹ thuật khác nhau để đánh lừa sự cảnh giác của nạn nhân. Trong tương lai, hiệu quả của các chiến thuật này có thể được nâng cao nhờ mạng nơ-ron nhân tạo. Do đó, các mối đe dọa mạng liên quan đến gian lận và lừa đảo có thể leo thang, dẫn đến sự gia tăng các cuộc tấn công. Điều này nhấn mạnh tầm quan trọng ngày càng tăng về kỹ năng sử dụng tài nguyên trên không gian mạng và an toàn thông tin từ phía người dùng cuối, đồng thời là các hệ thống bảo mật như IDS/IPS, tường lửa, DLP, phần mềm anti-virus,… mạnh mẽ để ngăn chặn các cuộc tấn công email lừa đảo và các mối đe dọa mạng khác.

Sự phân mảnh của các quy định về AI sẽ gia tăng

Mặc dù các chuyên gia đang ủng hộ mạnh mẽ việc hài hòa hóa các quy tắc AI, nhưng những lời kêu gọi đó sẽ cực kỳ khó thực hiện nếu xem xét sự khác biệt sâu sắc trong cách tiếp cận quy định AI. Ngược lại, nguy cơ bối cảnh quản lý AI toàn cầu trở nên rời rạc đã hiện hữu. Tuy nhiên, những căng thẳng địa chính trị gia tăng có thể sẽ có tác động tiêu cực đến đối thoại liên chính phủ và do đó, làm chệch hướng các nỗ lực nhằm khắc phục sự phân mảnh tiềm tàng trên toàn cầu của quy định AI.

Các bên liên quan thuộc khu vực tư nhân, đặc biệt là trong các doanh nghiệp, sẽ đóng một vai trò quan trọng trong việc định hình các quy tắc và thông lệ liên quan đến AI. Với chuyên môn sâu rộng trong việc phát triển và sử dụng AI, các tổ chức phi chính phủ có thể đưa ra những nội dung có giá trị cho các cuộc thảo luận về quy định AI ở cả cấp độ toàn cầu và quốc gia. Các nhà hoạch định chính sách trên toàn thế giới đã khai thác nguồn kiến thức quan trọng này, tích cực tìm kiếm ý kiến từ các doanh nghiệp, giới học thuật và xã hội để định hình hoạt động quản trị trong lĩnh vực AI.

Đào tạo nguồn nhân lực để tận dụng hiệu quả AI

Một cơ hội cho các nhóm an ninh mạng là phát triển những cách thức mới và sáng tạo để phát hiện và ứng phó với các mối đe dọa. Họ có thể sử dụng AI để tự động hóa các tác vụ và tạo ra nhiều giải pháp bảo mật thích ứng dành riêng cho doanh nghiệp và ngành an ninh mạng. Để làm được điều này, các tổ chức và doanh nghiệp cần phải quan tâm đến công tác đào tạo đội ngũ an ninh mạng.

Bằng cách thúc đẩy một môi trường làm việc, cộng tác và ứng dụng thực tế, lãnh đạo các doanh nghiệp có thể tạo cơ hội cho các phòng, ban và nhóm bảo mật của họ nắm bắt và tận dụng hiệu quả công nghệ AI, đặc biệt thông qua các buổi đào tạo và chia sẻ kinh nghiệm. Điều quan trọng là phải nhận ra rằng tích hợp AI là một hành trình và việc cung cấp sự hỗ trợ cũng như nguồn lực cần thiết sẽ góp phần vào thành công trong việc thích ứng với bối cảnh an ninh mạng đang phát triển này.

Các doanh nghiệp cần phải nhận ra tầm quan trọng của việc đào tạo nguồn nhân lực của mình cách sử dụng an toàn các chatbot phổ biến như ChatGPT, Microsoft Copilot (trước đây là Bing Chat) hoặc các công cụ khác sử dụng AI tổng hợp. Điều này có nghĩa là trong tương lai gần, chúng ta có thể thấy nhu cầu về các mô-đun chuyên biệt trong chương trình đào tạo nâng cao nhận thức về bảo mật dành riêng cho việc sử dụng AI.

Hơn nữa, sự phát triển nhanh chóng của AI sẽ có khả năng khiến các doanh nghiệp đưa ra các chính sách hạn chế sử dụng các sản phẩm AI cho các nhiệm vụ công việc, từ đó giảm thiểu nguy cơ rò rỉ dữ liệu. Ngoài ra, các doanh nghiệp cũng nên khuyến khích nhân viên tham gia các chương trình đào tạo liên quan và các hội nghị hoặc hội thảo tập trung vào AI trong lĩnh vực an ninh mạng.

Bảo vệ mô hình LLM

Việc áp dụng rộng rãi nhiều chatbot và mô hình LLM, đồng thời trao quyền cho các cá nhân thuộc nhiều nhóm ngành, nghề khác nhau, làm gia tăng mối lo ngại về quyền riêng tư và bảo mật của dữ liệu cung cấp cho các mô hình này. Điều này đặc biệt liên quan đến các doanh nghiệp và các thực thể lớn. Nhiều mô hình LLM được đào tạo trước phổ biến dựa trên các bộ dữ liệu công khai chứa thông tin nhạy cảm, điều này gây ra rủi ro lạm dụng hoặc không chắc chắn về việc liệu dữ liệu của doanh nghiệp được đưa vào các mô hình này có được giữ bí mật và không được sử dụng lại cho mục đích đào tạo hay không. Để giải quyết những lo ngại này, có thể có những xu hướng mới ủng hộ các Mô hình ngôn ngữ lớn tư nhân (PLLM) được đào tạo trên các bộ dữ liệu độc quyền dành riêng cho từng tổ chức hoặc ngành riêng lẻ.

Duy trì nền tảng vững chắc về các nguyên tắc an ninh mạng truyền thống

Điều này bao gồm bảo mật mạng, mật mã, kiểm soát truy cập và chính sách bảo mật. Duy trì những điều cơ bản này là việc cần thiết để xây dựng các biện pháp bảo mật hiệu quả xung quanh các hệ thống AI.

Có được sự hiểu biết nền tảng về học máy và học máy đối nghịch

Điều này bao gồm học tập có giám sát và không giám sát, học tập tăng cường, mạng lưới thần kinh và các thuật toán học máy phổ biến. Kiến thức này rất quan trọng để hiểu được khả năng và hạn chế của AI trong an ninh mạng. Bên cạnh đó, các doanh nghiệp cũng cần hiểu cách các mô hình AI có thể bị thao túng hoặc khai thác bởi các tác nhân đe dọa. Tìm hiểu các kỹ thuật để bảo mật các mô hình AI trước các cuộc tấn công mạng.

Phát triển kỹ năng về khoa học và phân tích dữ liệu

AI trong an ninh mạng thường liên quan đến việc xử lý và giải thích các bộ dữ liệu lớn. Tìm hiểu cách sử dụng dựa trên các ngôn ngữ lập trình như Python và các công cụ trực quan hóa dữ liệu để phân tích hiệu quả.

Kiểm thử xâm nhập

Các doanh nghiệp nên cập nhật thường xuyên các kỹ thuật kiểm thử, đánh giá hệ thống, các công cụ và phương pháp được thực hiện và định kỳ tiến hành kiểm thử xâm nhập. Hiểu rõ cách thức ứng dụng AI để xác định các lỗ hổng và mô phỏng các cuộc tấn công mạng. Mặc dù AI là một nền tảng hiệu quả trong lĩnh vực bảo mật, thế nhưng cần nhớ rằng là phải sử dụng AI kết hợp với kiến thức chuyên môn của con người cũng như hoạt động nghiên cứu và phát triển đang diễn ra. Sức mạnh tổng hợp này là rất quan trọng để đi trước các tác nhân đe dọa một bước.

|

TÀI LIỆU THAM KHẢO [1]. . [2]. . [3]. |

TS. Nguyễn Tiến Dũng (Học viện Cảnh sát nhân dân)

08:00 | 15/03/2024

08:00 | 11/06/2024

12:00 | 12/04/2024

14:00 | 22/05/2024

13:00 | 17/06/2024

14:00 | 19/02/2024

10:00 | 07/06/2024

15:00 | 20/09/2024

Chính phủ Úc có kế hoạch đặt ra giới hạn độ tuổi tối thiểu cho trẻ em sử dụng phương tiện truyền thông xã hội với lý do lo ngại về sức khỏe tinh thần và thể chất. Điều này đã gây ra phản ứng dữ dội từ những người ủng hộ quyền kỹ thuật số.

16:00 | 07/09/2024

Tạp chí An toàn thông tin xin giới thiệu toàn văn bài viết của Tổng Bí thư, Chủ tịch nước Tô Lâm nhân dịp Quốc khánh 2/9.

10:00 | 06/09/2024

Hà Lan vừa ban hành lệnh cấm toàn diện việc học sinh tiểu học và trung học mang điện thoại thông minh, đồng hồ thông minh và máy tính bảng đến trường. Đây là động thái mạnh mẽ nhằm giải quyết tình trạng xao nhãng và giảm khả năng tương tác xã hội của học sinh do các thiết bị điện tử gây ra.

14:00 | 05/08/2024

Giới hạn trí tuệ máy tính là bài toán mà nhà toán học lớn của thế kỷ 20-21 Steve Smale đã coi là thách thức của thế kỷ 21 và có thể là nhiều thế kỷ sau này.